OpenClaw 重大更新引发系统级故障:插件生态迁移与 Vibe Coding 的规模化挑战

3 月 22 日,微信官方宣布推出 ClawBot 插件,支持接入 OpenClaw。用户通过扫码或复制命令即可将其接入微信。然而仅仅两天后,OpenClaw 的一次版本更新便导致该插件失效。

OpenClaw 官方发布了 v2026.3.22 版本更新,将产品重新定位为跨平台个人 AI 助手。此次更新强制将其插件生态系统从公共 npm 仓库迁移至官方 ClawHub 市场,不再依赖开发者熟悉的 Node.js 标准包管理平台 npm。同时,旧版插件系统被移除,转而采用新的软件开发工具包。

新的公开插件 SDK 接口已调整为

openclaw/plugin-sdk/*;原来的openclaw/extension-api已被移除,且不提供兼容层。

这表明此次变更并非“来不及做兼容”,而是团队主动选择切断旧接口,强制推动生态迁移。

npm 长期以来一直是全球 JavaScript 开发者的通用基础设施,开发者可以自由发布和分发代码模块。但由于其开放性,历史上也长期存在恶意软件传播、依赖投毒等问题。此次,官方虽未直接声明“放弃 npm”,但通过产品设计给出了明确答案:npm 仍可使用,但已不再是 OpenClaw 重点押注的插件生态中心。

原生命令安装插件时,对于形似 npm 包名的插件,系统会优先在 ClawHub 中查找,再回退至 npm。

在 OpenClaw 的更新说明中,另一个值得注意的安全举措是:官方禁用了某些“隐式 workspace plugin 自动加载”行为,以避免用户克隆仓库后,插件代码在未经明确“信任决策”的情况下自动执行。结合 OpenClaw 生态近期暴露出的恶意 skills、供应链投毒和分发安全问题,此次重构旨在将插件体系从开放式分发转向官方可控的 registry、统一 SDK 和更强的执行边界。

错误频发:微信插件仅存活两天

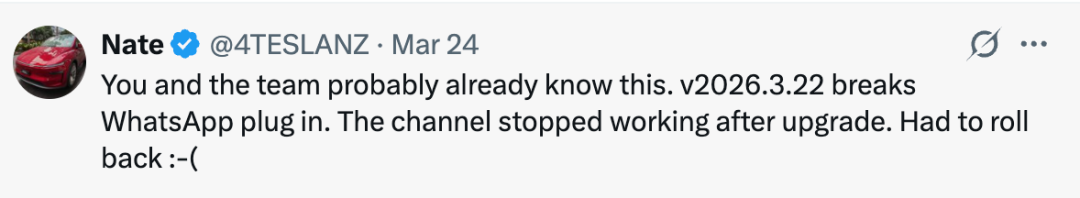

更新发布后,不少开发者遇到了问题,包括缺失 “dist/control-ui” 目录、系统崩溃等。有用户表示,自己的 WhatsApp 插件在更新后直接失效,不得不回滚至旧版本以维持服务。

OpenClaw 创始人 Peter Steinberger 随后回应称,此次问题的直接原因之一是发布流程中遗漏了与 web control UI 资源相关的步骤,导致当前版本无法正确加载对应内容。他建议用户先升级至已修复的 beta 版,或等待后续修复后的正式版本。

但问题显然不止于此。国内模型如 MiniMax 的配置失效、Windows 沙箱环境中的权限报错,以及使用了官方插件的微信、飞书、企业微信等平台均遭遇了“更新即崩溃”的问题。

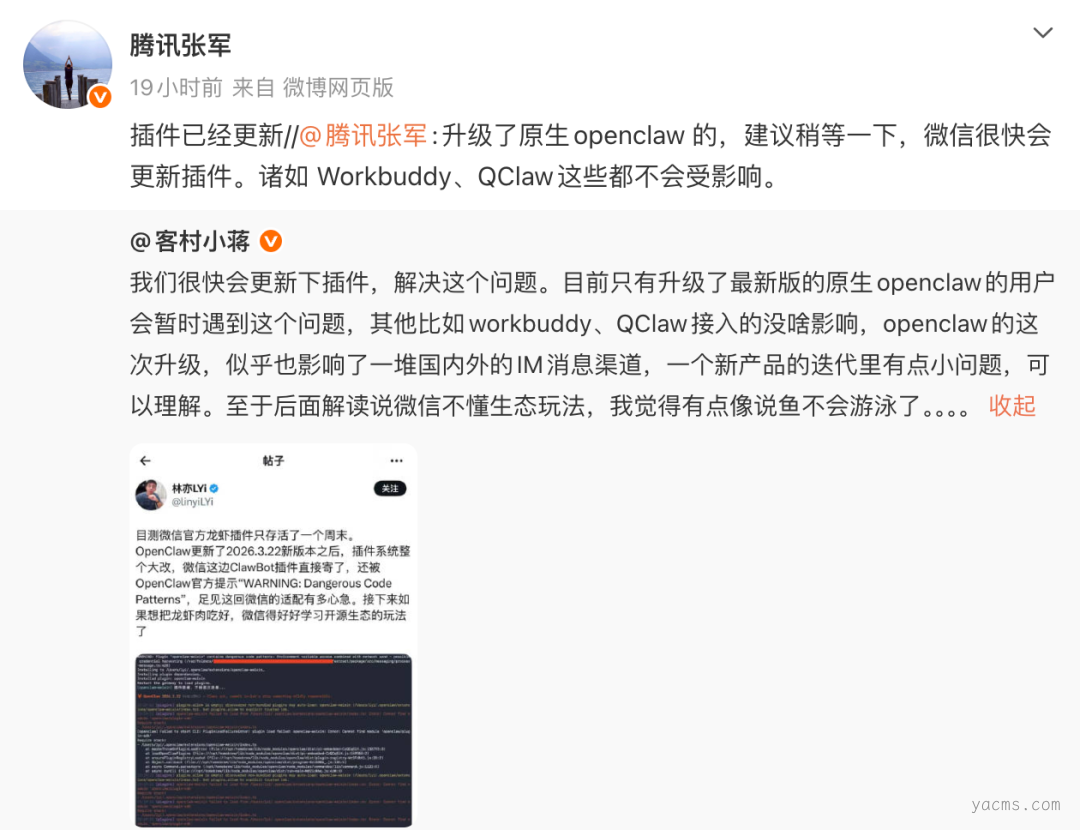

对此,微信员工 @客村小蒋 回应称:“openclaw 的这次升级,似乎也影响了一堆国内外的 IM 消息渠道,一个新产品的迭代里有点小问题,可以理解”。根据腾讯公关总监张军的说法,目前微信 Clawbot 插件已完成更新并修复相关问题。

可以看出,这并非由单一 bug 引发的局部失效,而是一次重构后,插件加载、消息通道、模型配置、沙箱权限、分发访问等多个环节同时出现问题,暴露的是系统级脆弱性,而非单个模块缺陷。

此次故障的核心在于,所有插件现在都必须上传至 ClawHub 才能运行,但大量旧插件并未完成迁移。与此同时,版本升级带来的访问洪峰压垮了 ClawHub 本身,触发了严格的限流机制,导致用户既无法访问旧插件,也无法顺利下载新插件。Peter 也承认,平台限流规则设置过严,后续将放宽限制以恢复正常访问。

因此,此次升级很快被部分用户评价为“一次糟糕的更新”。

OpenClaw:不再是可以随意“爆改”的实验项目

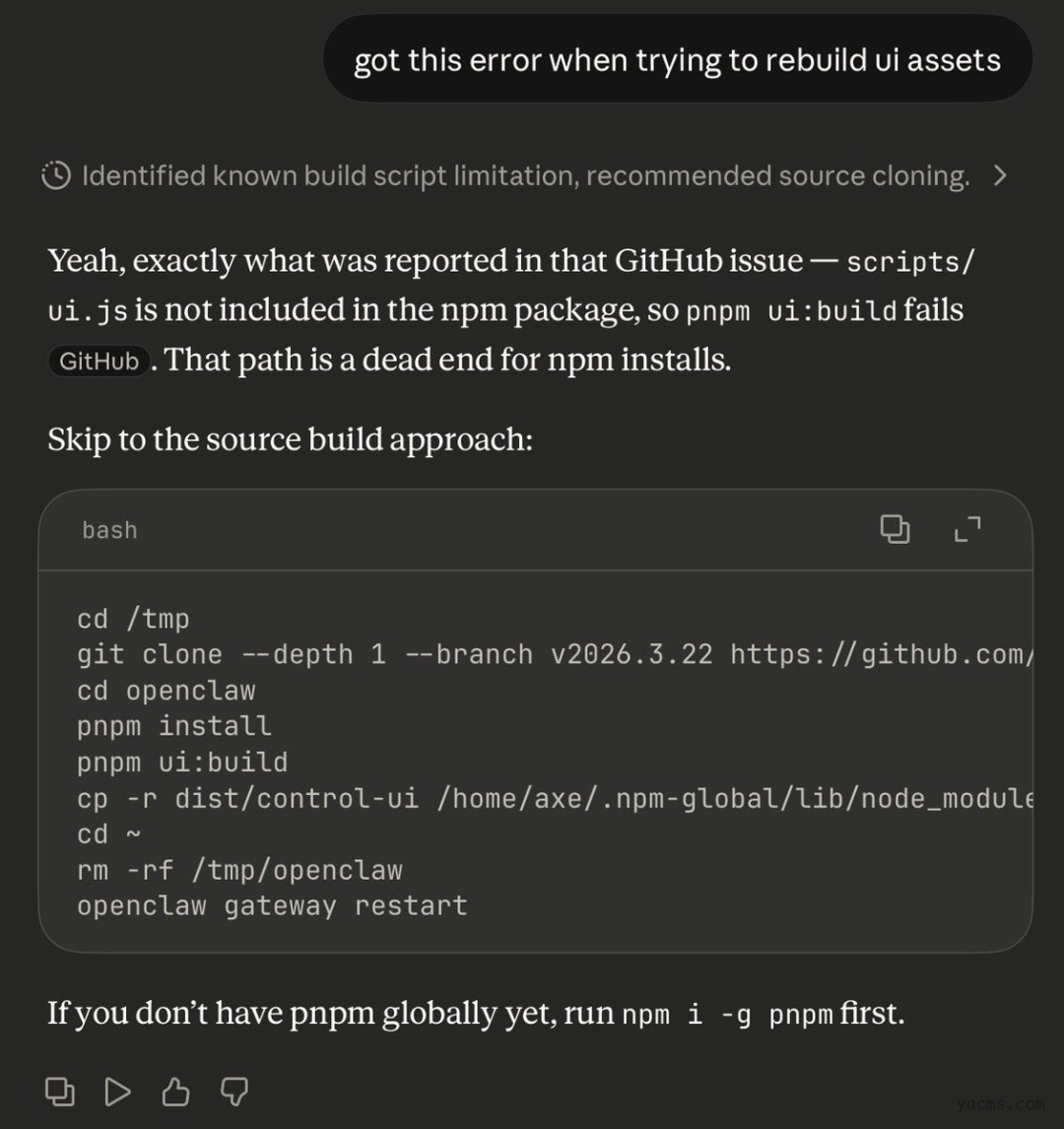

故障发生后,一些开发者开启了“自救”模式。

“它把那个和 memory-lancedb 都搞砸了,但我卸载了 LDB 内存插件,进入 TUI,重新安装了它,然后输入了网关启动时的错误信息,尝试了两次之后,我又恢复正常了!比一般的调试过程简单多了。”

某种意义上,这场事故甚至演变成了一场由 AI 协助修复 AI 的现场排障。有用户利用 Claude、Cursor 等工具进行救场。

此次事故可能也暴露出,OpenClaw 已不再是一个可以随意进行激进修改的实验性项目,而是开始被要求像基础设施一样具备稳定性。

有用户在升级至 beta 版后留言称,他们目前有 8 个 agent 通过 OpenClaw 全天候 24/7 运行,因此系统稳定性对他们而言至关重要。他们感谢官方在问题说明上的透明度,同时也认为,在当前的采用规模下,自动化端到端测试流水线将带来实质性的帮助。

如果当时有更完整的自动化端到端测试,此次许多故障大概率能在正式发布前暴露出来。区别于针对单个函数或组件的单元测试,端到端测试用于验证从开始到结束的完整流程,模拟真实用户场景,确保系统的所有组件作为一个整体正确运行。Peter 透露,他正在推动整个发布流程自动化,并为 web 端补充端到端测试。

整体来看,此次 OpenClaw 更新虽然优先考虑了开发者体验和系统安全,但未能做好可用性与用户体验之间的平衡。由于缺乏充分的兼容性规划、流量压力测试以及流畅的用户过渡方案,一次本意为“升级”的变更最终演变成了一场重大故障。

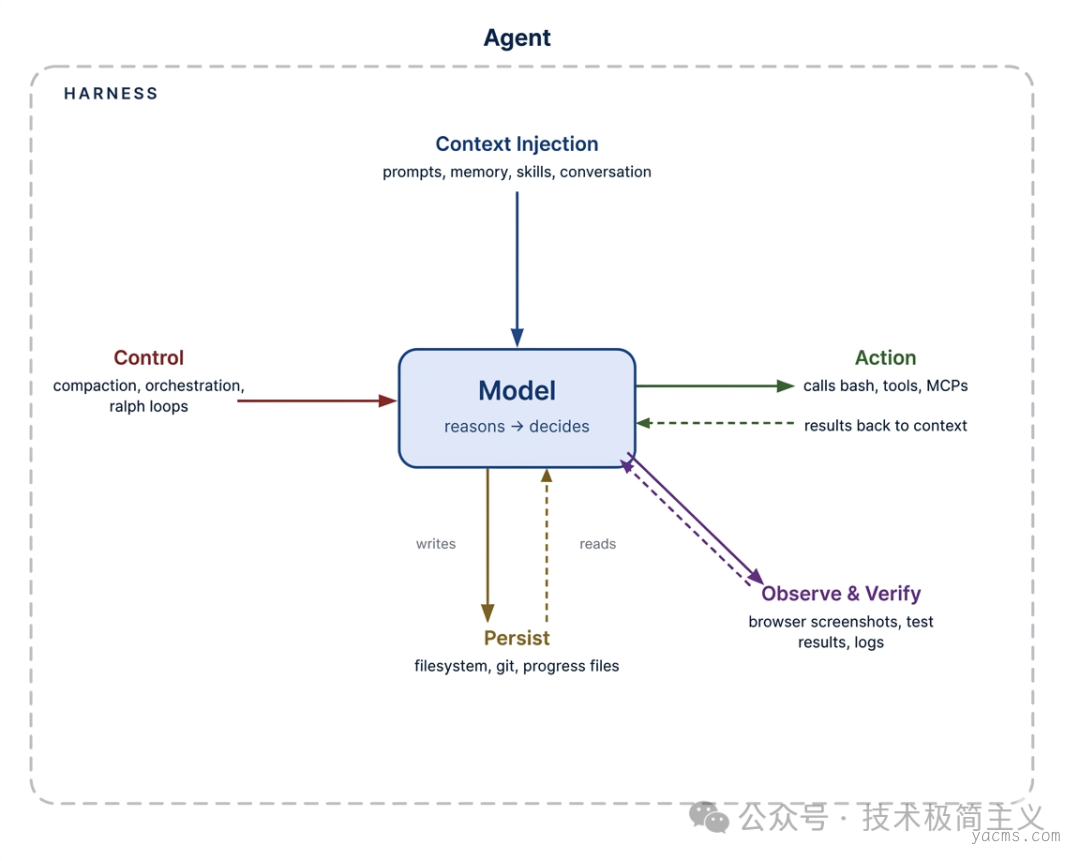

当 Vibe Coding 进入大规模生产环境

OpenClaw 本身就是 Vibe Coding 浪潮的产物。Peter 的开发方式颇具代表性:他摒弃了传统的逐行编码方式,转而组织一个由 AI 组成的开发团队:用 Claude Code 入门,以 Codex 作为主力,让多个 agent 同时运行,通过不断生成、验证和修正,快速将产品实现。他本人专注于系统架构与方向把控,而 agent 则负责代码生成、测试、调试等机械性工作。

“我真的很在意整体结构。但我没有把每一行代码都读一遍,因为很多代码说白了就是枯燥的‘管道工程’。”他说道。

此前就有开发者吐槽:“OpenClaw 的多线程和定时器一定写的一坨屎。”他评价道,当下 AI Coding 的能力,若没有精细化的人为干预,是做不好的,预计还需要迭代很久,因为“AI 的屎山也是屎山”。

OpenClaw 早期的全量版本通常包含庞大的生态插件和架构,部分分析指出其总代码量(包含依赖与插件库)可能达到 40 万行级别。目前,OpenClaw 的 PR 数量正以惊人的速度增长。“我昨天干了一整天,提交了大约 600 次代码。之前是 2700,现在已经超过 3100 了。”

他表示,自己需要一个 AI 来扫描每一个 PR 和 Issue 并进行去重,它还应该能根据各种信号判断哪个 PR 才是“最靠谱的那个版本”。他打算先在 OpenClaw 的基础上自己构建一个这样的工具,而 token 消耗已不在他的考虑范围之内。

大量由 AI 生成的代码此前就导致 OpenClaw 经常出现故障,目前该平台依然频繁出现各种问题。

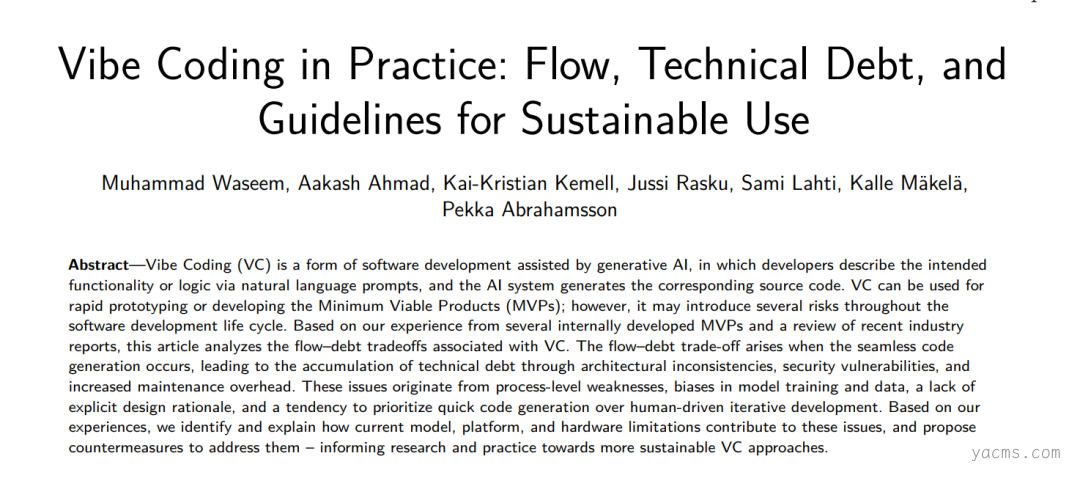

而此次更新事故也恰好为 Vibe Coding 的未来发展敲响了警钟。正如由高校研究者和行业实践团队共同发布的论文《Vibe Coding in Practice: Flow, Technical Debt, and Guidelines for Sustainable Use》中所指出的:Vibe Coding 在前期探索阶段的确高效,但许多团队会不知不觉地将“适合快速试错”误认为“适合一路推进到生产环境”,而这往往正是技术债务失控的起点。

需求看似更完整,实则可能更模糊

Vibe Coding 往往从自然语言提示开始,但自然语言最大的问题在于其天然不够精确。

论文指出,许多团队的起点往往是类似“帮我做一个支持用户注册、后台管理和数据统计的系统”这样的高层描述。这样的提示足以让 AI 快速开工,却未必足以让它做对。模型可能“自作聪明”地补上你没有要求的功能,也可能忽略那些你没明确写出、却决定系统能否真正上线的关键要求。

最容易被遗漏的,恰恰是那些非功能需求:安全、性能、可靠性、可维护性、可扩展性。这些内容不会像“做一个登录页”那样直接写进 prompt,但却决定了系统最后能否投入真实使用。论文特别提到,许多本应成为设计前提的架构关键需求,在 Vibe Coding 过程中会被悄悄省略。结果就是,功能看起来越来越齐全,底层质量属性却从一开始就没有被认真考虑。

你以为在搭建系统,实际上可能只是在“拼布”

架构不一致,是 Vibe Coding 的另一笔隐形债。

很多项目直接从 prompt 跳到代码,中间缺少系统性的架构设计:一个页面是这么生成的,另一个模块是后来补的,第三个服务又是在下一轮生成时顺手改出来的。短期看,功能似乎不断增加;但时间一长,整个系统就容易变成一块拼布。

论文举了一个很典型的例子:某个基于微服务的系统,在一次重生成之后,把原本基于 JWT 的认证方式改成了 session cookie。表面看只是局部调整,但结果却是其他依赖它的服务全部开始报 401。类似的情况还包括 API 字段名悄悄变化,导致前端集成测试瞬间全面失效。

这类问题最麻烦的地方在于,它们不是某一行代码写错了,而是系统边界在多轮生成中被慢慢侵蚀了。因此,那些看起来很“传统”的工程方法,在 Vibe Coding 时代反而变得更重要:职责分层、架构文档、领域建模、边界约束,都没有过时。AI 越强,系统越需要明确边界。

安全问题不是“以后再修”,而是一开始就在长

论文作者团队还用 agent 式安全扫描器检查了 7 个早期 vibe-coded MVP,共发现 970 个安全问题,其中 801 个是高危问题。这个数字本身已经足够说明问题。

这些漏洞并不冷门,恰恰是开发里最常见也最危险的那些:路径遍历、不安全存储、硬编码密钥、命令注入、XSS、不安全反序列化、缺失认证检查。更关键的是,很多问题不是单个文件的孤立错误,而是在系统快速拼接的过程中自然长出来的。

这意味着,如果团队把 Vibe Coding 仅仅理解成“先做出来,安全以后再补”,那么从第一版开始,风险就已经在不断累积。

代码越长,你反而越不理解它

AI 生成代码的另一个陷阱在于:它看起来很完整,却未必真正可维护。

论文中提到,在多轮生成之后,某个系统后端甚至出现了两份 database.py,函数名略有差异,两份文件都能运行、看起来都没问题,但真正被调用的其实只有一份。之后 AI 在下一轮修改时又调错了模块,最终引发静默错误,只能靠人工逐个文件排查根因。

这说明,AI 确实能让代码飞快增长,但它不会自动帮你维持结构秩序。如果团队没有文档、没有依赖关系追踪、没有代码清理机制,系统最后就很容易变成“能跑,但没人敢动”。

测试看起来有了,不等于系统真的被验证了

Vibe Coding 确实很容易生成测试,但这些测试往往只覆盖最理想的 happy path。边界条件、错误处理、异常状态、非功能需求很容易被忽略。有些测试甚至只是模型自己生成的一套 mock,运行当然能通过,却并没有真正验证系统。

例如某个原型系统的认证流程测试一直是绿的,但真实登录流程其实早就坏了。原因不是逻辑没测,而是测试根本没真正走到真实 session 逻辑里,只是在调用模型生成的伪造响应。于是测试通过了,系统却根本没被验证。

本地能跑,不代表可以上线

Vibe Coding 还有一个非常现实的问题:代码生成速度,已经快过了部署护栏建设速度。

很多项目在本地环境中每个模块都能跑起来,但一旦进入 CI/CD、集成环境或生产部署阶段,问题就会集中爆发:依赖不一致、环境变量错配、端口冲突、构建失败、回滚困难。论文因此强调,AI 生成代码最多只能算“第一稿”。真正要进生产环境,仍然必须经过 lint、类型检查、回归测试、可观测性、自动回滚等完整工程流程。否则,本地 demo 再漂亮,也扛不住真实业务压力。

最后

OpenClaw 这次出问题,表面上看是一次插件系统重构引发的大面积兼容性事故,但也可能是一个典型的 AI 原生产品,从“快速生长”走向“规模化生产”时,撞上的第一堵墙。

一个靠 AI 和开源社区高速生长出来的产品,生态可以迅速做大,但平台治理、发布流程、安全边界和兼容性体系,却往往来不及同步成熟。这也是日后留给 OpenClaw 们的一道课题。

评论

发表评论