大模型时代已经到来,作为前端同学如何在业务中切入模型的调用,我认为组件库是一个非常好的着手点。接下来就跟着我一起来完成一个基于Langchain的AI助手吧。

1.效果展示

最终效果就是通过自然语言询问AI助手某个组件属性和用法,这比通过查文档快得多,当然也可以直接接入到MCP中,在代码中直接使用AI助手来完成代码补全。

最终效果就是通过自然语言询问AI助手某个组件属性和用法,这比通过查文档快得多,当然也可以直接接入到MCP中,在代码中直接使用AI助手来完成代码补全。

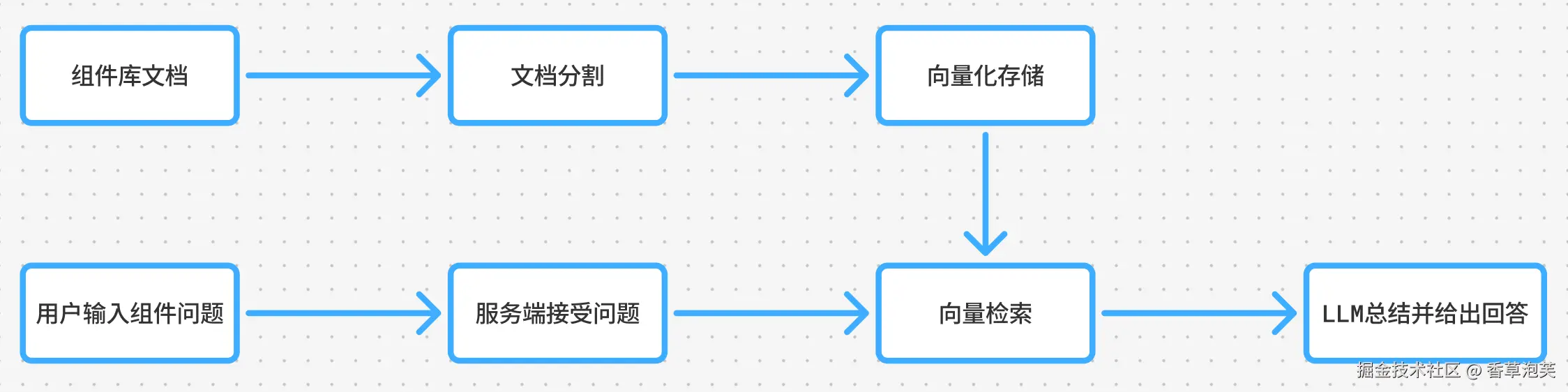

2.流程设计 先大体展示一下助手的整个流程设计

上面有两条工作流,第一条是向量存储的过程,首先需要组件库的文档说明示例,再将文档读取转化为字符串,接着使用Langchain框架自带的RecursiveCharacterTextSplitter进行片段分割,最后使用embedding进行向量化存储。

第二条工作流为Nodejs服务+Langchain框架+LLM模型共同工作给出回答,首先服务端接受用户输入的问题,然后根据用户提问在向量存储库中进行RAG检索,最终结合LLM大模型给出答案。

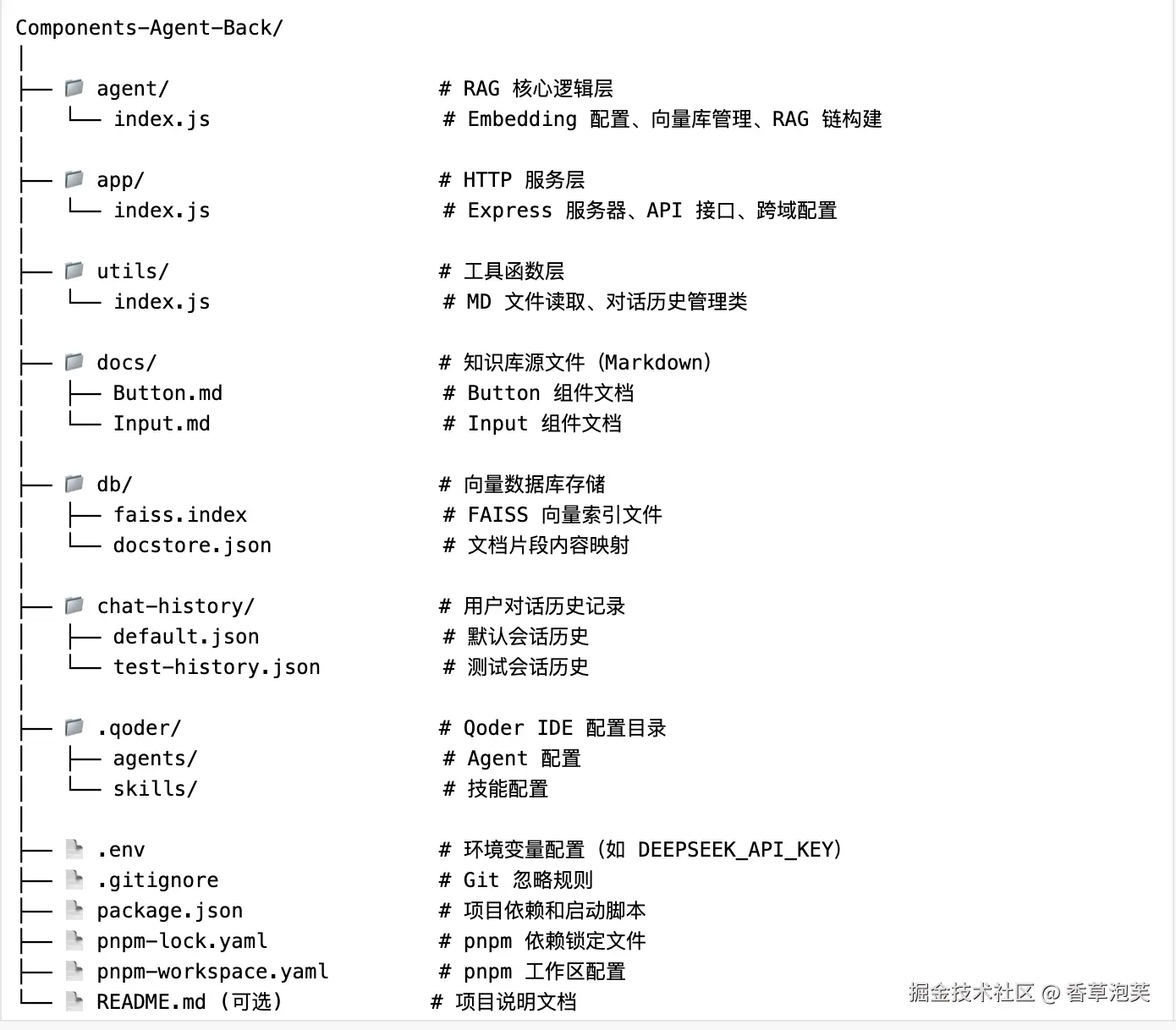

3.准备工作 首先实现第一条工作流中的第一步,创建一个服务端项目,这里我使用的是Express框架。项目目录如下:

别担心我们会一步一步实现所有代码。

作者:香草泡芙 链接:https://juejin.cn/post/7616583079419379747 来源:稀土掘金 著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。

评论

发表评论